Um das iPhone, das iPad und den Mac auch mit Einschränkungen nutzen zu können, gibt es bereits zahlreiche Bedienungshilfen unter iOS, iPadOS und macOS. Der Hersteller Apple hat zusätzlich zu diesen eine ganze Sammlung neuer Hilfsmittel vorgestellt, die sich an Nutzer/innen mit kognitiven, visuellen, auditiven oder motorischen Einschränkungen richten. Weiterhin wurden Werkzeuge präsentiert, die sich an Menschen richten, welche nicht sprechen können oder bei denen der Verlust der Sprachfähigkeit abzusehen ist. Die neu vorgestellten Bedienungshilfen für iPhone, Mac und iPad funktionieren direkt auf den Geräten und werden durch lokales maschinelles Lernen verbessert.

Kapitel in diesem Beitrag:

- 1 Die neuen Bedienungshilfen für iPhone und iPad

- 2 Assistive Access für die Reduzierung auf das Wesentliche

- 3 Das sind Live Speech und Personal Voice

- 4 Point and Speak für den Erkennungsmodus der Lupe-App

- 5 Neue Bedienungshilfen am Mac sowie weitere Informationen

- 6 In der Pressemitteilung genannter Fahrplan

- 7 Ähnliche Beiträge

- 8 Sir Apfelot Wochenschau KW 16, 2025

- 9 Was bringt iOS 19 aufs Apple iPhone? (Gerüchteküche)

- 10 Apple-Updates: x.4.1-Versionen sollen Bugs und Sicherheitslücken beheben

- 11 iPhone 6s und 2018er Mac mini jetzt auf der „Vintage“-Liste

- 12 10 Jahre Aktivitätsringe: 24. April 2025 als Aktionstag für Watch-User

- 13 PDF Secure: Am iPhone PDFs mit Passwort versehen oder sie davon befreien

- 14 Mac-Trick: Keine Spaces anzeigen, wenn Fenster an oberen Displayrand gezogen werden

- 15 Fenstermanagement und Produktivität: iPadOS 19 soll näher an macOS rücken

Die neuen Bedienungshilfen für iPhone und iPad

„Wir bei Apple haben immer daran geglaubt, dass die beste Technologie die ist, die für alle gemacht ist“, sagt Tim Cook, CEO von Apple. „Heute freuen wir uns sehr, neue Funktionen vorzustellen, die auf unserer langen Erfahrung aufbauen, Technologie zugänglich zu machen, damit alle die Möglichkeit haben, kreativ zu sein, zu kommunizieren und das machen zu können, was man liebt“, kann man in der Pressemitteilung zum Thema lesen. In dieser sind die einzelnen neuen Funktionen und Hilfsmittel inklusive Erklärungen und Screenshots aufgeführt. Es handelt sich um diese Neuerungen:

- Assistive Access

- Live Speech

- Personal Voice

- Point and Speak für den Erkennungsmodus der Kameralupe

- Kopplung von MFi-Hörgeräten mit dem Mac

- Neue Phonetik-Funktionen für die Sprachsteuerung

- Schaltersteuerung

- Einfachere Anpassung der Textgröße

- Abschalten von Animationen für Menschen, die auf schnelle Bewegungen reagieren

- Die Sprachrückmeldung von VoiceOver klingt nun auch bei höherer Geschwindigkeit natürlich

- „Remember This“ als Kurzbefehl für ein visuelles Tagebuch in den Notizen

- Und einiges mehr! (s. Pressemitteilung)

„Barrierefreiheit ist Teil von allem, was wir bei Apple machen“, sagt Sarah Herrlinger, Senior Director of Global Accessibility Policy and Initiatives bei Apple. „Diese wegweisenden Funktionen sind unter Berücksichtigung des Feedbacks aus den Communities von Menschen mit Einschränkungen entwickelt worden, um eine Vielzahl von Nutzer:innen zu unterstützen und Menschen zu helfen, sich auf neue Weise zu verbinden.“

Assistive Access für die Reduzierung auf das Wesentliche

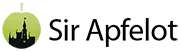

Für Menschen mit kognitiven Einschränkungen ist das neue Hilfsmittel Assistive Access gedacht. Dieses reduziert die Darstellung von einigen Apps und ihren Inhalten auf wesentliche Funktionen. Als ein Beispiel hat Apple die Fotos App gezeigt, deren Symbol und Name am oberen Rand der Anzeige zu finden sind. Darunter sind Fotos in einem großen Gitter angeordnet. Ein großer Zurück-Button führt zur Ordnerübersicht. Auch für die Kamera, Anrufe, die Musik App und Nachrichten gibt es Vorschaubilder.

Das sind Live Speech und Personal Voice

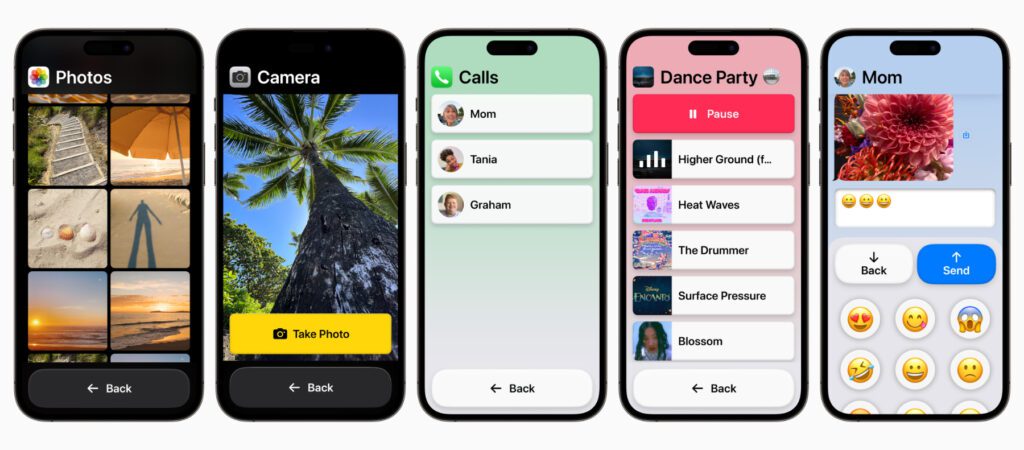

Live Speech ist eine Funktion, die am Mac, am iPhone und am iPad geschriebene Inhalte in Sprache umwandelt. So können Menschen mit Spracheinschränkungen oder ohne Sprachfähigkeit die einzelnen Geräten bei Telefonaten und FaceTime-Anrufen für sich sprechen lassen. Häufige Phrasen lassen sich abspeichern, damit sie nicht immer aufs Neue eingegeben werden müssen. Das lässt zudem schnelle Reaktionen in schnellen Gruppengesprächen zu.

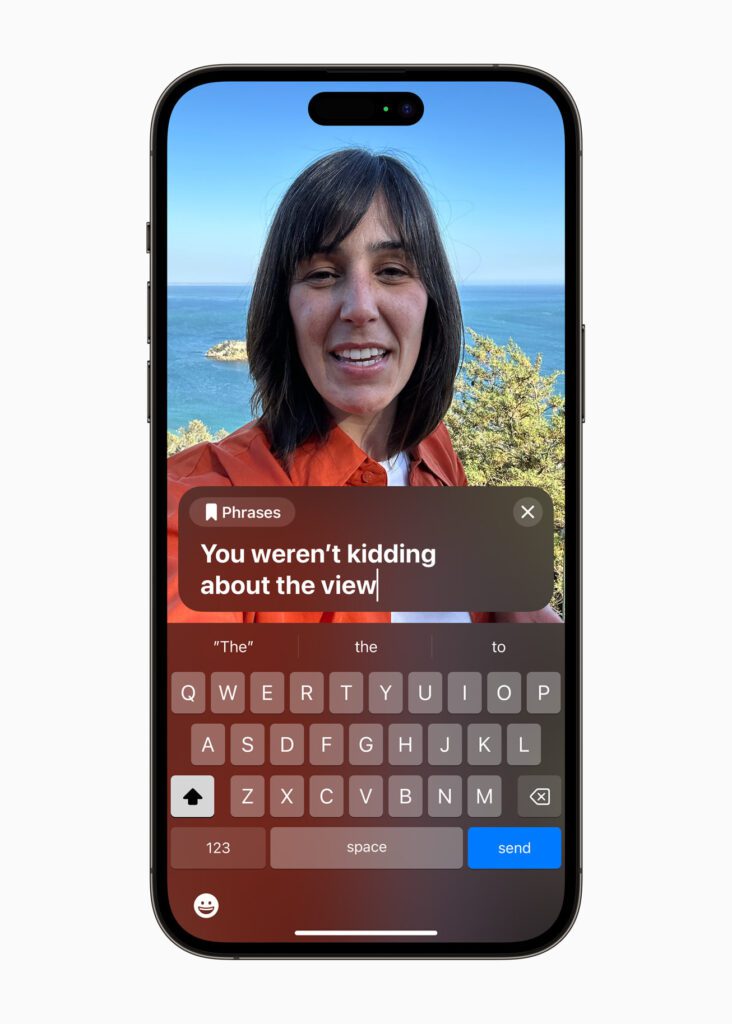

Personal Voice hingegen ist eine Sprachfunktion, welche mit der eigenen Stimme trainiert wird. So kann die eigene Stimme angewendet werden, wenn die Sprachfähigkeit – etwa durch die Erkrankung mit ALS (Amyotrophe Lateralsklerose) oder aus einem anderen Grund – womöglich verloren gehen könnte. Am iPad und iPhone soll es ausreichen, 15 Minuten lang vorgegebene Textaufforderungen einzusprechen, um durch lokales Machine Learning die Personal Voice zu erstellen.

„Am Ende des Tages ist es das Wichtigste, mit Freunden und Familie kommunizieren zu können“, sagt Philip Green, Vorstandsmitglied und ALS-Befürworter bei der gemeinnützigen Organisation Team Gleason, der seit seiner ALS-Diagnose in 2018 erhebliche Veränderungen an seiner Stimme erfahren hat. „Wenn man ihnen sagen kann, dass man sie liebt, und zwar mit einer Stimme, die wie die eigene klingt, macht das den Unterschied aus — und dass man seine künstliche Stimme in nur 15 Minuten auf dem iPhone erstellen kann, ist außergewöhnlich.“

Point and Speak für den Erkennungsmodus der Lupe-App

Wird die Kameralupe des iPhones verwendet, dann kann schon jetzt eine Reihe von Erkennungsmöglichkeiten genutzt werden. Diese sollen mit Point and Speak derart erweitert werden, dass erkannte Texte durch Zeigen ausgewählt und vom Gerät vorgelesen werden. Hält man das iPhone etwa vor eine Mikrowelle mit beschrifteten Tasten, dann werden die einzelnen Elemente und ihre Beschriftung erkannt. Legt man dann den Finger auf eine Taste, wird ihre Beschriftung vorgelesen. Hier agieren die Kamera, der LiDAR-Scanner und das lokale maschinelle Lernen zusammen.

Neue Bedienungshilfen am Mac sowie weitere Informationen

Apple listet in der Pressemitteilung zum Thema noch weitere neue Bedienungshilfen für die Barrierefreiheit an den verschiedenen Geräten auf. Für den Mac gibt es zum Beispiel die Kopplung mit MFi-zertifizierten Hörgeräten. So können Systemtöne, Anrufe, Musik, Filme, Serien, Podcasts und mehr direkt vom Mac auf die Hörhilfen übertragen werden.

Die Sprachsteuerung wird zudem zukünftig um eine Wort-Auswahl für phonetisch ähnlich klingende Begriffe erweitert. So müssen Nutzer/innen, die eine Texteingabe mit der Stimme realisieren, keine überdeutliche Aussprache bemühen. Als Beispiele nutzt Apple in der Pressemitteilung englische Begriffe – etwa „do“, „due“ und „dew“. Im folgenden Screenshot seht ihr sind zudem ähnlich klingende Worte wie „peak“, „peaked“, „peace“, „pea“, „beak“, „pick“ und so weiter zu finden.

Über die Systemeinstellungen und den dortigen Bedienungshilfe-Bereich wird es zudem einfacher werden, die Schriftgröße in einigen Apple-eigenen Apps anzupassen. So kann bei einer Einschränkung der Sehfähigkeit schneller und einfacher ein größerer Text für Kalender, Finder, Mail, Nachrichten und Notizen festgelegt werden – App-spezifisch lassen sich individuelle Textvergrößerungen nutzen.

In der Pressemitteilung genannter Fahrplan

Dass Apple selbst im deutschen Pressetext die englischen Begriffe für die neuen Bedienungshilfen verwendet und auch englischsprachige Screenshots verwendet, zeigt, dass die Einbindung dieser neuen Funktionen noch etwas Zeit braucht. Möglicherweise werden sie erst im Juni mit der WWDC23 ausgerollt. Ein genauer Zeitplan wird nicht präsentiert. Möglich ist auch, dass die neuen Funktionen erst im Herbst 2023 mit iOS 17, iPadOS 17 und macOS 14 erscheinen. Apple könnte sie jetzt schon ankündigen, um auf der WWDC-Keynote Zeit für andere Inhalte einzusparen; etwa für das Mixed-Reality-Headset und das neue xrOS.

Trotz der fehlenden Angaben zur Veröffentlichung der neuen Bedienungshilfen gibt es einen Fahrplan in der Mitteilung. Denn begleitet werden die neuen Bemühungen für die Barrierefreiheit unter iOS, iPadOS und macOS mit einem Service-übergreifenden Rahmenprogramm. So startet morgen, am 18. Mai 2023, in Deutschland, Italien, Spanien und Südkorea der Einsatz von Gebärdensprache im Apple Store und beim Apple Support. Zudem wird es in ausgewählten Apple Stores weltweit Infoveranstaltungen zu den neuen Funktionen geben. Die Apps Podcasts, Apple TV, Bücher und Musik bekommen Sammlungen und Playlists zu ausgesuchten Themen sowie unterstützende Zusatzinhalte / -Funktionen.

„Diese Woche in Apple Fitness+ integriert Trainerin Jamie-Ray Hartshorne ASL und hebt all die Funktionen hervor, die Anwender:innen zur Verfügung stehen und Teil der andauernden Bemühungen sind, Fitness für alle zugänglicher zu machen. Zu den Funktionen gehören Audio-Hinweise, die zusätzliche kurze, beschreibende verbale Hinweise geben, um blinde oder Nutzer:innen mit eingeschränktem Sehvermögen zu unterstützen […]“, heißt es außerdem zu Apples Trainingsangebot. Alle weiteren Infos, zusätzliche Barrierefreiheit-Funktionen und mehr Events findet ihr in der verlinkten Pressemitteilung Apples.

Ähnliche Beiträge

Johannes hat nach dem Abitur eine Ausbildung zum Wirtschaftsassistenten in der Fachrichtung Fremdsprachen absolviert. Danach hat er sich aber für das Recherchieren und Schreiben entschieden, woraus seine Selbstständigkeit hervorging. Seit mehreren Jahren arbeitet er nun u. a. für Sir Apfelot. Seine Artikel beinhalten Produktvorstellungen, News, Anleitungen, Videospiele, Konsolen und einiges mehr. Apple Keynotes verfolgt er live per Stream.